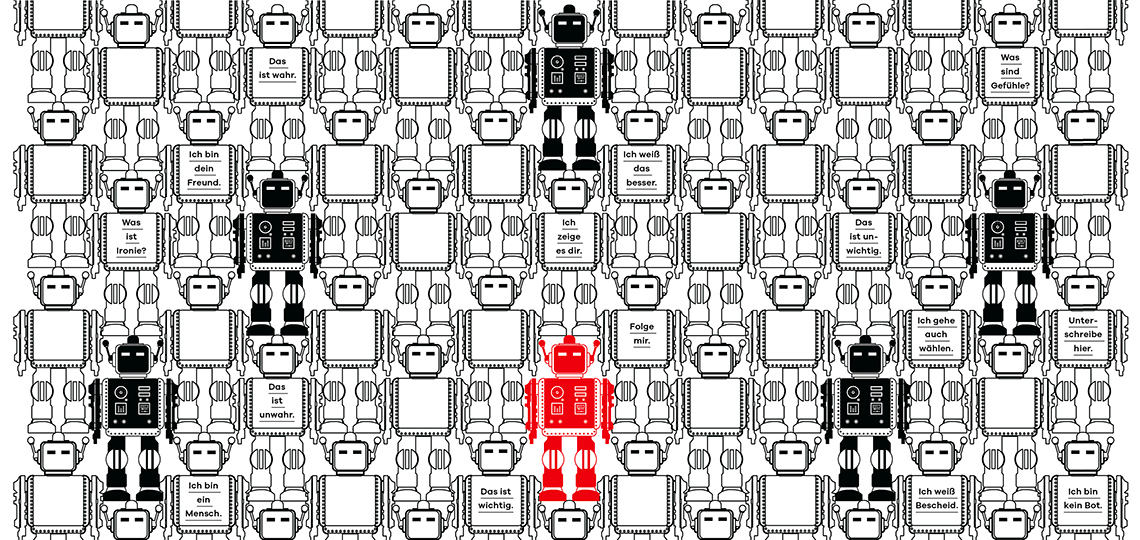

Die sozialen Online-Netzwerke bieten Millionen von Kontakten, doch manche Nutzer sind gar nicht echt, sondern programmierte Identitäten. Social Bots bestehen aus Algorithmen, die als Menschen getarnt öffentliche Meinung steuern oder Daten sammeln sollen. Eine Gefahr?

Text Wolfgang Scheidt

Bundestagswahlkampf 2017, ein Rückblick: Spitzenkandidaten aller Parteien schienen auf Plakaten omnipräsent. Lohnt sich der Aufwand? Sind Plakate und TV-Bilder von Politikern noch wirksam? Oder werden Social-Media-Kampagnen mit Facebook, Twitter, Social Bots & Co. die neuen Meinungsmacher und Mehrheitsbeschaffer? Programmierte Identitäten sind Realität. Die CDU erwog im Wahlkampf den Einsatz von Chatbots, die FDP testete via Twitter, Anfragen per Bots beantworten zu lassen. In der Wirtschaft sind Chatbots im Kundenservice Usus, auch Barack Obama nutzte sie, um etwa Autogrammwünsche zu bearbeiten. So weit, so gut. Kritisch wird es erst, wenn Bots simulieren, dass hinter ihnen Menschen stehen, und sie durch Postings in sozialen Online-Netzwerken die öffentliche Meinung manipulieren.

„Unter Bots versteht man Nutzer in den sozialen Netzwerken, die vollkommen autonom durch eine Software gesteuert werden. Das kann nützlich sein, zum Beispiel um aktuelle Nachrichten zu verbreiten“, erklärt Simon Hegelich, Professor für Political Data Science an der Hochschule für Politik der TU München. Social Bots beruhen auf bestimmten Algorithmen. Sie simulieren eine menschliche Präsenz im Word Wide Web und täuschen mit ihrer falschen Identität andere Nutzer. So lässt sich eine virtuelle Dominanz von Themen oder Absendern erzeugen. „Diese Programme können massenhaft Meldungen verbreiten, die dann eventuell für echte Meinungen gehalten werden“, warnt Hegelich. Die kleinen, wendigen Computerprogramme sind so programmiert, dass sie sich über Fake-Nutzerprofile online in Profile und Kommentare oder Chats einklinken können. Ihre Mission: Informationen sammeln, Nutzer auf bestimmte Seiten locken, Produkte promoten, Petitionen unterschreiben oder Meinung machen.

DIGITALE MEINUNGSMANIPULATION

Hegelich nennt drei Gruppen von Social-Bots-Nutzern. Erstens: Unternehmen, die Werbung für Produkte machen. Zweitens: Klickbetrüger, die Geld damit verdienen, Nutzer auf bestimmte Seiten zu lenken. Drittens: politische Aktivisten, Geheimdienste und Regierungen, sei es in der Flüchtlingsdebatte, im Wahlkampf oder beim Brexit. Der neueste Trend heißt Spear-Phishing: Ein Social Bot entwickelt sich automatisch zum perfekten Freund einer bestimmten, realen Person, um diese dann gezielt, etwa per Schadsoftware, zu manipulieren. Doch auch für Social Bots gilt: No Bot is perfect. „Alles, was einem merkwürdig vorkommt, sollte man ernst nehmen“, empfiehlt Hegelich. „Wieso hat jemand in kürzester Zeit bereits 10.000 Tweets gesendet? Wieso kriege ich Freundschaftsanfragen von Leuten, die ich nicht kenne, die aber irgendwie alle gleich aussehen? Sollte ich etwas glauben, nur weil Millionen andere es liken?“ Auch sprachliche Stilmittel wie Humor oder Ironie sind Social Bots fremd.

Das Phänomen der Meinungsmanipulation durch künstliche Intelligenz stand mehrfach auf der Agenda von Ausschusssitzungen des Bundestages. Beim W-Forum des Wissenschaftlichen Dienstes bezifferte Hegelich das größte bislang bekannte Bot-Netz auf 350.000 Fake-Accounts. Mindestens zehn Prozent der Twitter-Accounts sollen in Deutschland maschinengesteuert sein, um damit gezielt Desinformationskampagnen zu steuern. Überwiegend seien Social Bots jedoch „Werbe-Schleudern“ ohne politische Ambitionen, urteilte Hegelich bei der Veranstaltung. Das Kalkül: Je mehr begeisterte Follower und Fans, umso größer die Akzeptanz und möglicherweise auch der Absatz.

Für die Politik gab Hegelich beim W-Forum Entwarnung. Der Einfluss von Social Bots funktioniere nicht wie ein Automatismus. „Nur weil irgendwer eine Bot-Meldung liest, ändert er oder sie deshalb die eigene Meinung nicht. Was die Bots allerdings sehr gut können, ist, Trends zu verzerren“, legte der Wissenschaftler dar. Zum Glück hätten die meisten Nutzer ein eher geringes Vertrauen in die sozialen Online-Netzwerke, verwies Hegelich auf gesellschaftliche Kräfte, die als Korrektiv stark genug seien.

RENT AN SOCIAL BOT

Der Datenexperte Dirk Helbing, Professor für Computational Social Science an der ETH Zürich, ist skeptischer als Hegelich. Studien hätten gezeigt, dass Bots die Stimmenanteile um sechs bis zwanzig Prozent verändern könnten. „Man muss davon ausgehen, dass Wahlen schon seit Jahren beeinflusst werden, zunächst von bezahlten Leuten, die für den Staat tweeten, beispielsweise in Russland. Heutzutage geht das billiger“, berichtete Helbing im Interview mit BR24. So koste es nur etwa 1.000 Dollar, sich 100.000 Social Bots zu mieten. „Und die können wesentlich subtiler, effektiver und massiver beeinflussen“, warnte der Experte. Social Bots würden nicht von den politischen Parteien bestellt. Sie könnten auch von Unternehmen oder von ausländischen Regierungen oder Geheimdiensten stammen. Entsprechende Aktivitäten spielten offenbar im französischen Präsidentschaftswahlkampf eine große Rolle. Helbing gehört zu denen, die den Kern der Demokratie durch automatisierte Netzpropaganda bedroht sehen: „Die vielleicht größte Gefahr ist, dass das Prinzip der ‚Weisheit der Vielen’, welches der Demokratie zugrunde liegt, untergraben wird.“

Sollten Social Bots also verboten werden? Solche Vorschläge hält Christian Grimme, wissenschaftlicher Mitarbeiter am Institut für Wirtschaftsinformatik und Statistik der Universität Münster, für unrealistisch, weil Verbote technisch gar nicht durchsetzbar seien. Stattdessen appelliert er an den gesunden Menschenverstand. „Wer aufgeklärt an diese Medien herangeht und weiß, dass nicht alles dort so echt und repräsentativ ist, wie es scheint, der kann sie auch sicher und in vielen Fällen sinnvoll nutzen.“

Bot

Substantiv [der]

Computerprogramm, das weitgehend selbständig sich wiederholende Aufgaben abarbeitet. Kommunizieren einzelne Bots über ein Netzwerk miteinander, handelt es sich um ein Botnet. Textbasierte Dialogsysteme mit natürlichsprachlichen Fähigkeiten werden als Chatbots bezeichnet.

Foto: rosepistola.de

Syquallo/Shutterstock.com

Porträt: privat

Alle Artikel

Alle Artikel